AIをめぐる話題は、まだまだ衰えそうにない。それどころか、素早いスタートアップに続いて、大手メディアソフトウェア企業もこの新興分野に乗り出すようになっている。その最たる例が、数カ月前に独自のジェネレーティブAIを発表したAdobeだろう。新しいツールをどのように自社のソフトウェアに統合するつもりなのか、控えめに言っても、非常に野心的だ。私たちはベータ版に参加し、Adobe Fireflyをテストして、その現在の機能を徹底的に解説した。その結果、「Midjourney」の精密さにはまだ及ばないが、必ずやその域に達するだろう。

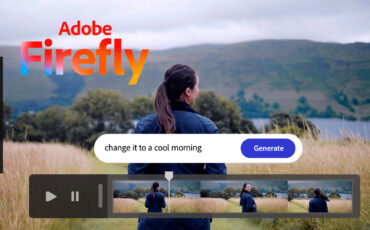

NAB2023で、アドビは、迅速で簡単なビデオ制作のためにFireflyの機能を拡張する計画も明らかにした。これにより、AIにテキストコマンドを与えてショットの配色を変更したり、スクリプトから直接、完全にスケッチされたストーリーボードを生成したりすることができるようになる。Make previz」をクリックしてコーヒーを飲みに行けば、ニューラルネットワークがディープラーニングで鍛えた脳を駆使して、フル3Dのビジュアライゼーションを作ってくれるだろう。

冗談はさておき、アドビの計画がどのように結実するかは見守る必要がある。今のところ、私たちが評価できるのは、Fireflyのテキスト画像生成機能、クリエイティブなテキストエフェクトのための追加機能、ベクターの再カラーリングなど、すでに存在し、テストランに利用できるものだけだ。

Adobe Fireflyとは、どのようなもので、どのようにテストするのか?

Fireflyは、AI駆動のツールと生成モデルに完全に焦点を当てた、アドビの新しい研究分野だ。開発者は画像やテキストのエフェクト生成から始めたが、それだけにとどまることはないだろう。彼らの本質的な目標は、クリエイティブなワークフローをスピードアップして改善するあらゆる方法を考え出し、それをPhotoshop、Premiere Pro、InDesignといったアドビの既存製品に統合することだ。

Fireflyは、アドビが過去40年にわたり培ってきた技術を自然に発展させたものであり、人々が自分のアイデアを思い描いたとおりに世界に送り出すことができるようになるべきだという信念に基づいています。

Quote from Adobe Firefly’s website

ベータ版に参加することで、アドビはユーザーに既存モデルの開発を手伝ってもらうだけでなく、新たに役立つ機能を提案してもらうことを奨励している(以下、より詳細な情報は続く)。Fireflyのテスターになるには、ここで「Join the beta」をクリックし、招待状を待つだけだ。

これを入手すれば、ブラウザ(デスクトップのChrome、Safari、Edgeを含む)で直接Adobe Fireflyを使用することができる。AIベータ版は現在、タブレットやあらゆるモバイルデバイスをサポートしていないことに注意していただきたい。

Adobe Fireflyのインターフェースと操作性

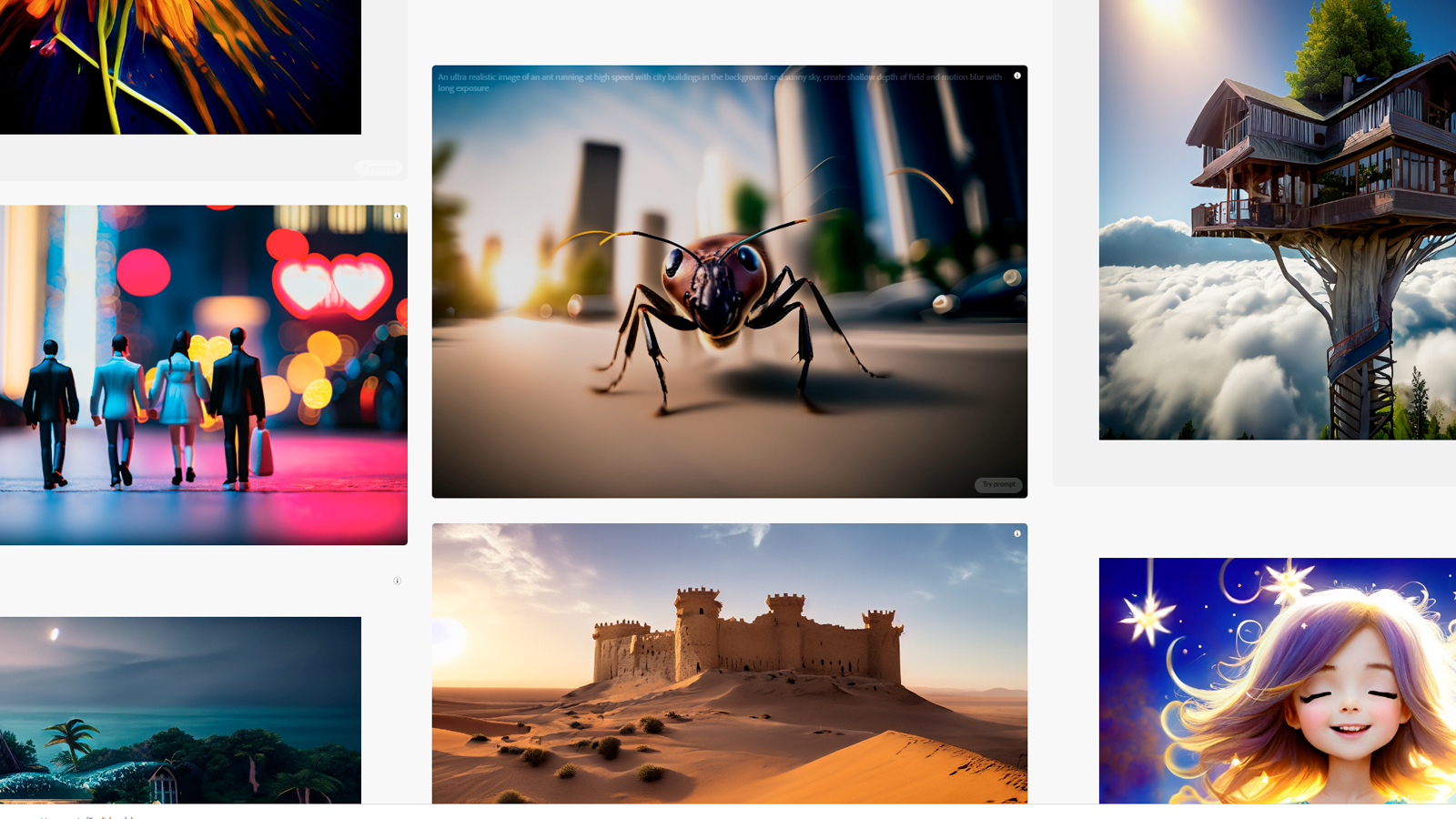

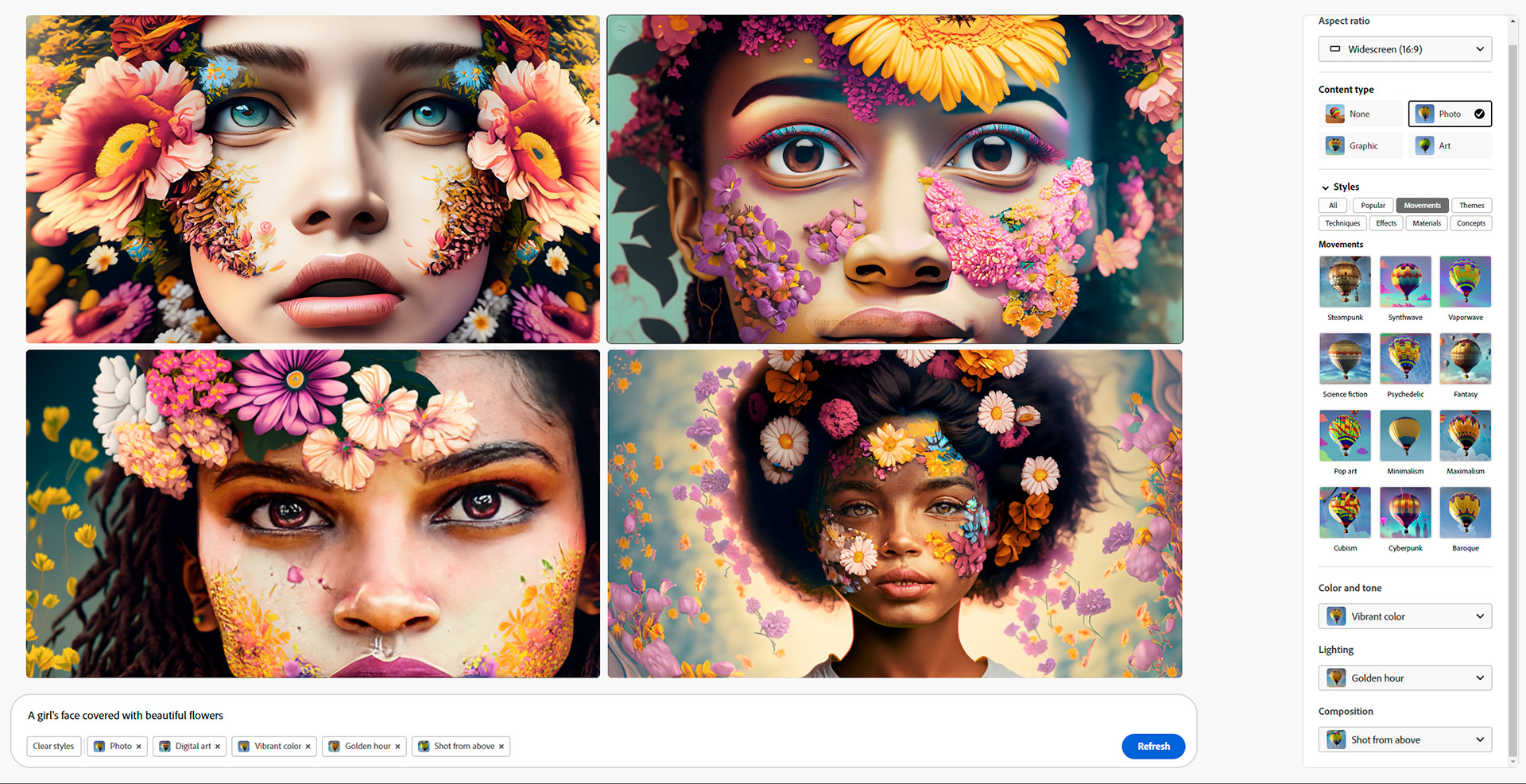

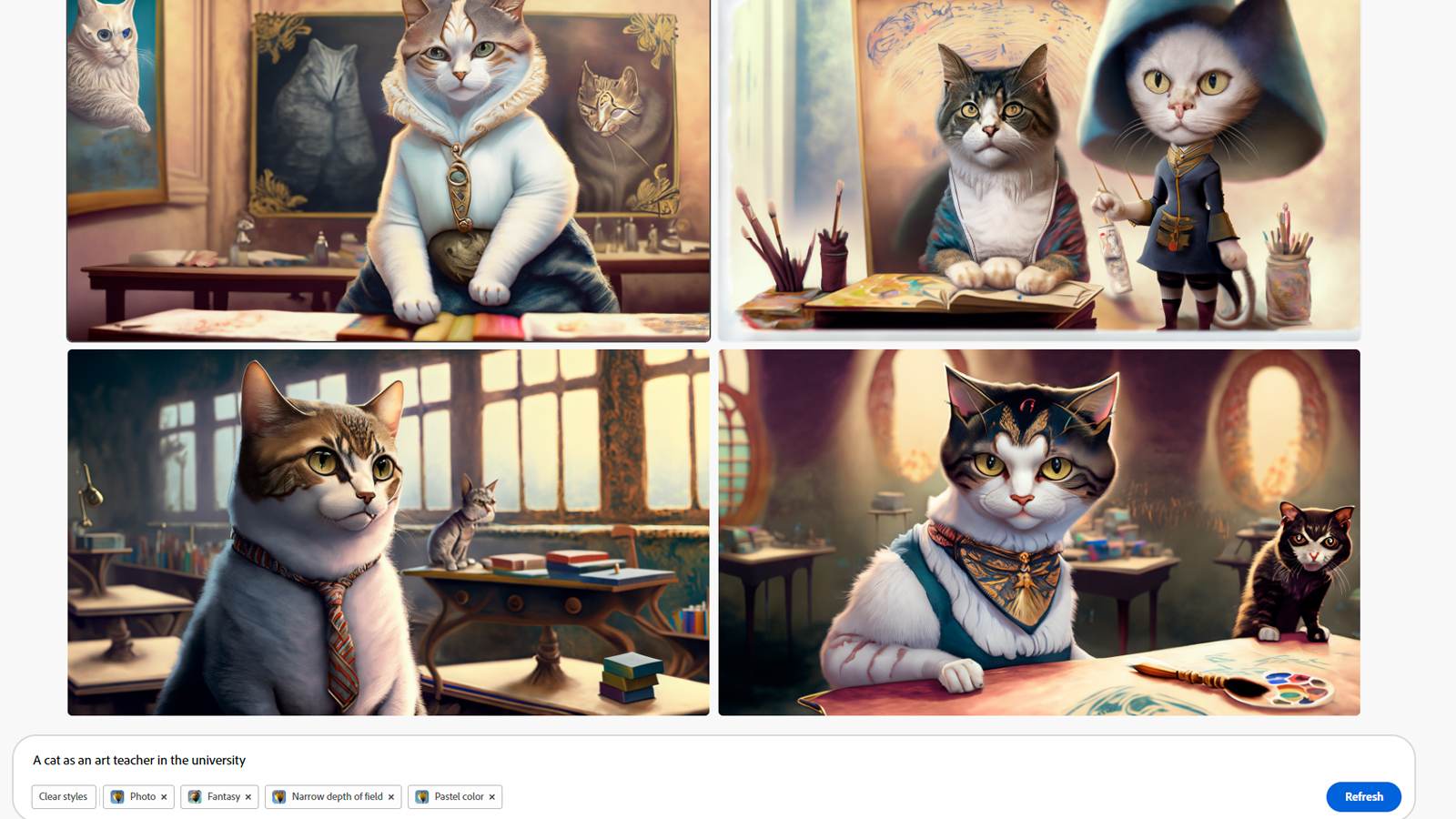

MidjourneyやStable Diffusionのような他の有名なテキストから画像へのジェネレータ(レビューはこちら)をすでに知っている場合、Adobe Fireflyのインターフェースはあなたを驚かせるだろう。少なくとも、これが私の第一印象だった。非常に使いやすいだけでなく、多くのクリエイティブなパラメータを備えており、非常に簡単に遊ぶことができる。別のアスペクト比が必要ならボタンを押せばいい。コンテンツの種類を写真からグラフィックに変更したい場合もボタンを押すだけだ。パステルカラーのパレットにしたい場合もボタンを押すだけだ。

基本的に、それらのスタイルを変更すると、プログラムは下のテキストプロンプトに言葉を追加したり、そこから言葉を発したりする。しかし、より良い結果を得るためにチャットボットとチャットしなければならないMidjourneyと比較すると、この表面は画期的なソリューションのように感じられる。不思議なのは、さまざまなパラメータで遊んでいる間に、すでに生成した画像にそのパラメータを適用するようモデルに依頼したり、「Refresh」をクリックしてまったく別の画像セットを得ることができること。下のコラージュは、同じ女の子を対象にした3つの微妙に異なるスタイルのテストを組み合わせて、異なる結果を得ている。

しかし、何度かテストした結果、正直なところ、パラメータは必ずしも約束通りには機能しないことがわかった。まだ魔法ではないので、構図のプロパティを変えても、「上から撮った」のと同じ画像が即座に得られるわけでは無い。また、Fireflyは、ワイドレンズで撮った写真を数秒でマクロ写真に変換することはできない。アドバイスとしては、「生成」をクリックする前に、すべてのスタイル設定を選択することだ。

画像の上にマウスを置くと、左上に「show similar」というボタンが表示さ れる。これをクリックすると、さまざまなバリエーションが表示さ れる。また、アドビはライブストリームで定期的に役立つヒントを紹介している。

Adobe Fireflyのテスト:フォトリアリズムはまだ得意では無い

最初のテストとして掲載した、花で覆われた少女の生成された顔をもう一度見てみよう。どうでしょう?まず、すごいですね!ホタルは、1つの画像セットの中で、全く異なる国籍や人種を提供しているのが良い。開発者は、AIモデルが偏らないようにトレーニングしていることをよく強調するが、ここではその成果をはっきりと見ることができる。

同時に、この結果を実際の写真と混同しないようにしたい(今回の画像生成ではコンテンツタイプに「写真」を選択したが)。私だけがそう思っているわけではない。Adobeのライブストリーミングのコメントでも、他のユーザーが、Fireflyが人物生成においてフォトリアリズムの点で遅れていることに気づいている。もしかしたら私たちは、飛躍的な発展を遂げ、すでにAIコミュニティで「フォトリアリズムの驚異」の称号を持つMidjourneyに甘えすぎているのかも知れない。私の最初の印象を裏付けるために、同じテキストプロンプトを両方のアプリケーションで試してみた:

ここでは、Adobe Fireflyがリアルな手足を作るのに苦労していることがわかる。これは、すべてのディープラーニングモデルが開発段階で直面する問題だ。良いニュースは、クリエイターがそれを理解し、認めていることだ。ベータテスターがシナリオによっては奇妙なアーティファクトに遭遇することは避けられないが、ニューラルネットワークは学習を続け、徐々に良くなっていくだろう。また、インテリアや風景の生成を依頼した場合、すでにはるかにスムーズな結果が得られている。

高速かつシンプルなテキストエフェクト

次に試したのは、テキストエフェクトジェネレーターだ。このツールも同様に、スタイルを説明するプロンプトを入力し、変更したいテキストを追加して楽しむだけだ。ここでは、CineDのロゴをハイテクなスチームパンク風にアレンジしたものを紹介しよう:

例えば、テキスト色の変更(実際には機能しません)、背景色の変更(機能するが、透明度とテキストのアウトラインに問題があり、開発者は時間をかけて改善すると約束している)、エフェクトをどこまで伸ばすかを決定することができる。FireflyのDiscordで見つけたヒントの1つに、テキストプロンプトに[outline-strength=10 (variable 10-100)]を追加して、少し余計なカオスを作り、効果要素をさらにその枠からはみ出すことが提案されている。

何度か試してみたところ、テクスチャ+カラーのように、2つか3つの単純な特性だけを記述すれば、より良い結果が得られることがわかった。それ以上でもそれ以下でもない。そうすることで、ミニマルでありながら、わかりやすいエフェクトが完成する。

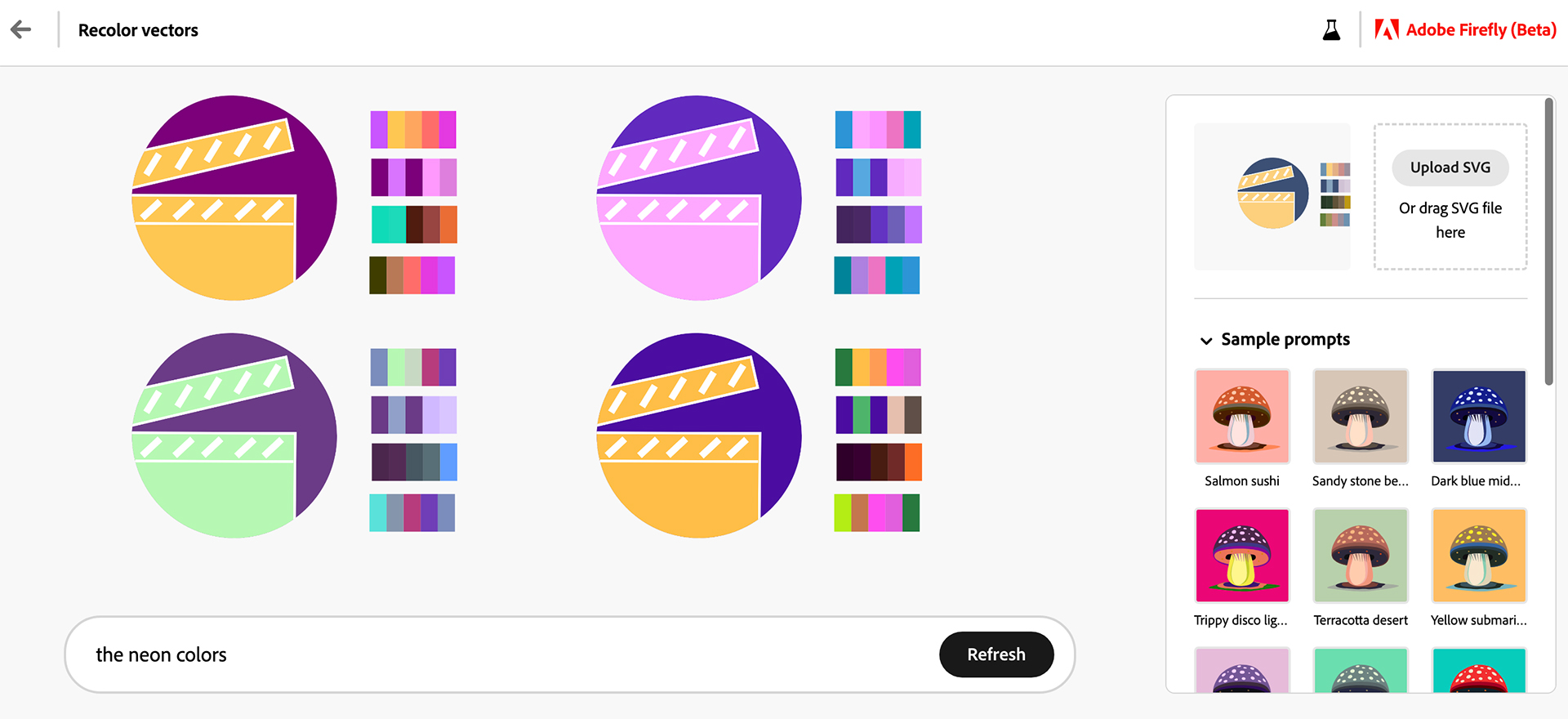

Adobe Fireflyでベクターを再カラーリングする

これは、1週間前にもなかった新鮮なツールだ。もっとも、私はベクターを扱うことはあまりないので、手動で色を塗り直すことがどれほど難しいかはわからない。それでも、人工知能に試してみることにした。

この例では、私のInstagramから映画のスレートのシンプルなアイコンを取り出し、Fireflyにネオンカラーのパレットを適用してもらった。結果は私の期待に応え、SVGファイルとしてダウンロードすることも可能だ。デザイナーが最終的なバリエーションとしてクライアントに持っていくかどうかはわからないが期待している。

FireflyのAIはどのようなデータで学習されているの か

この質問は、人工知能分野の倫理に関する大きな議論の一部であるため、間違いなく私の好みの質問だ。他のデベロッパーと比較して、Adobeは別個の、そして同時に最も合法的な方法を取ることにした。彼らは、Adobe Stockの画像、オープンライセンスの映像、著作権が切れたパブリックドメインのコンテンツのみを使用して、Fireflyのモデルを訓練すると述べている。

これにより、有害なコンテンツや偏ったコンテンツに対してディープラーニングのメカニズムをキュレーションすることができ、またアーティストの所有権や知的財産権も尊重することができる。また、将来的には、Fireflyが生成したコンテンツを商業プロジェクトで自由に使用できるようになることも意味している。

制限事項

- Adobe Fireflyは、現在、ビデオコンテンツのアップロードやエクスポートをサポートしていない

- 例えばStable Diffusionで可能なように、自分の映像でモデルをトレーニングすることはできない(これは長所であり、同時に短所でもある)

- まだベータ版だが、Fireflyは非商用目的でのみ使用できる(そして、生成された画像には、上記の例で気づいたように、目に見える透かしが入る)

- 今のところ、Adobeの生成AIは英語のプロンプトしかサポートしていない

- このリリースでは、作成した作品をCreative Cloudに保存することはできない(この機能は、将来的に有効になる見込みだ)

- Fireflyでは、Stockサイトで商用利用可能な公人の写真のみを使用するため、有名人のユーモラスな画像やブランドのモックアップを作成することはできない(編集用コンテンツは除く)

その他、今年予定されている機能

Adobe Fireflyを使った画像生成は、まだ完璧とは言えないが、そのAIがどのように進化し続けるかを観察するのは、とてもエキサイティングだ。開発者は、今年中にベータテストを開始する予定のさまざまな機能を予告している。例えば、画像拡張、スマートポートレート、インペインティング機能などだ。

また、この技術をアドビのアプリケーションでどのように使うか、エキサイティングなアイデアがあれば、Firefly Discordサーバーに参加して、エンジニアと直接話すことができる(Adobe Communityフォーラムのメンバーであれば、そこでもできる)。彼らはフィードバックを受け付けており、テスターが将来のAIの探求に参加することを奨励している。

まとめ

ベータ版の目的は、Adobeがいつか我々のワークフローをスピードアップするようなクールな新しいツールを作るのを助けることなので、Fireflyのユーザーにはすべてのバグを報告し、生成された結果を評価するように求めている。すべての画像にサムズアップ/ダウンボタンがあり、フィードバックを提供するためのレポートツールも用意されているので、インターフェースから直接行うことができる。

Feature image: created with Adobe Firefly by CineD.