Netflixが提供するEyeline Studiosは 、複雑な顔のパフォーマンスをリライティングできる拡散ベースのフレームワークDifFRelightを発表した。同社の研究は、目の反射やセルフシャドウイングのような複雑な効果も再現する正確なライティングコントロールで、フラットライトのフェイシャルキャプチャを画像やダイナミックシーケンスに変換する方法を特徴としている。Netflixのアイライン スタジオによるDifFRelightの詳細は以下の通り。

VFXやカラーグレーディングを定期的に行わなくても、AIのリライティング機能についてはすでに耳にしたことがあるだろう。例えば、DaVinci Resolveには昨年からポストプロダクションで人工的にリライティングするツールが統合されている。Netflix Eyeline Studiosによる新しいDifFRelightは、より視覚効果のスペシャリストをターゲットにした異なるフレームワークだ。しかし、その結果を見ることは、特に技術に精通していない私たちにとっても興味深いかもしれない。

DifFRelight by Netflix Eyeline Studiosの要点

DifFRelightは、既製のツールでもなければ、ユーザーがシーンの照明を変更するものでもない(少なくとも今のところは)。これは、Eyeline Studiosがここで発表したフレームワークだ。開発者たちは、平坦な照明の入力を複雑な照明のシーンに変えることができる方法を実演している。彼らの例では、さまざまな顔のパフォーマンスと、肌の質感や髪のような詳細な特徴を保持しながら、照明状況がどのようにそれらをリアルにサポートするかを示している。

方法

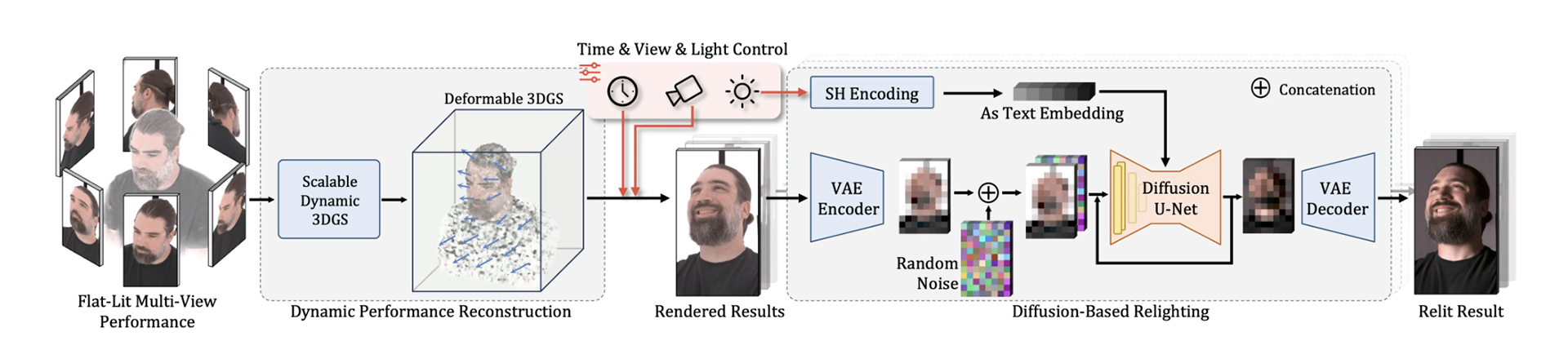

提案されたワークフローでは、研究者はGS再構成(「GS 」は 「Gaussian Splatting 」を意味する)からレンダリングされたパフォーマンスを入力として使用し、その結果、フラットライト映像が得られる。

ニュートラルな環境での被写体のマルチビューパフォーマンスデータからスタートし、デフォーマブル3DGSをトレーニングして、ダイナミックシーケンスのノベルビューレンダリングを作成する。これらは拡散ベースのリライティングモデルの入力として機能し、ペアデータでトレーニングすることで、フラットな照明の入力画像を、指定された照明に基づくリライト結果に変換する。

フレームワークの説明から引用

次に、フラットライト入力は、事前に訓練された拡散ベースの画像間変換モデルを通過する。このモデルは、Eyeline Studiosによれば、光のサイズと方向を調整することで、新しい照明条件を構築することを可能にする。一般的に、彼らの提示したアプローチは、自由な視点や未知の表情からの再照明を可能にする。

このプロセスやモデルの学習方法を技術的に詳しく理解したい場合は、こちらから研究論文にアクセスできる。

3Dガウス スプラッティングとは

コメントで指摘されているように、『DifFRelight』はNetflixにとって初の3DGS公開となる。3D Gaussian Splattingと呼ばれるこの技術は、すでにしばらく前から存在している。例えば、Luma AIのように、現実の環境のよりリアルで高速な3Dスキャンを実現するために、NeRF技術の代わりにこの技術を統合したAI企業もある。

このトピックの説明はVFX分野の専門家に任せたいので、私がフォローしているYouTubeチャンネルから、3Dガウス スプラッティングを多用するクリエイターの短いビデオを紹介しよう:

Feature image source: Netflix Eyeline Studios